Was bleibt von einem KI-Tool, wenn das Vertrauen kippt?

Warum der Pentagon-Deal von OpenAI meinen Blick auf ChatGPT verändert hat – und weshalb Datenschutz, Haltung und echte Alternativen plötzlich wichtiger werden.

Nach Schätzungen des App-Analyseanbieters Sensor Tower stiegen die Deinstallationen der ChatGPT-App in den USA Ende Februar 2026 um 295 Prozent gegenüber dem Vortag. Das ist keine offizielle App-Store-Zahl, sondern eine modellbasierte Marktanalyse. Genau deshalb ist sie interessant: nicht als harte Messung eines vollständigen Exodus, sondern als deutliches Signal dafür, wie schnell Vertrauen kippen kann, wenn aus einem Alltags-Tool plötzlich ein Politikum wird. TechCrunch und it-daily berichten von einer spürbaren Gegenreaktion in den Bewertungen und davon, dass Claude bei den US-Downloads zeitweise vorbeizog. Das ist noch keine Massenflucht. Aber es ist ein selten klares Vertrauenssignal.

Was hier sichtbar wird, ist größer als ein PR-Problem für OpenAI. Es ist ein Moment, in dem aus einem Produkt ein Politikum wird. OpenAI kündigte am 9. Februar 2026 an, eine angepasste ChatGPT-Version auf GenAI.mil zu bringen – also auf die KI-Plattform des US-Verteidigungsministeriums für unklassifizierte Arbeit. Wenige Wochen später beschrieb OpenAI weitere Schutzmechanismen für Einsätze in klassifizierten Umgebungen und ergänzte nach der Kritik zusätzliche Klarstellungen. Reuters berichtete am 3. März, dass OpenAI die Vereinbarung nachträglich präzisierte, um Grenzen deutlicher zu machen.

Mich beschäftigt daran nicht nur die militärische Dimension. Mich beschäftigt vor allem, wie schnell wir uns daran gewöhnt haben, KI nur noch als nützliches Werkzeug zu betrachten: als Schreibassistent, Denkpartner, Recherchehilfe oder Ideengenerator. Alles richtig. Aber genau darin liegt auch das Problem. Je enger ein Tool in unseren Alltag rückt, desto weniger ist es bloß Software. Es wird Teil unserer Routinen, unseres Denkens, unserer Sprache. Und genau deshalb ist es eben nicht egal, wofür dieses System sonst noch eingesetzt wird.

Ich nutze seit 2022 aktiv unterschiedlichste KI-Tools – ChatGPT sogar seit seiner Einführung im November 2022. Seit Sommer 2025 arbeite ich zusätzlich mit ChatGPT Pro. KI ist für mich längst ein selbstverständlicher Teil des Alltags geworden, weil sie mir viele Dinge spürbar erleichtert. Umso länger war ich bereit, für ChatGPT zu zahlen, weil ich geglaubt habe, dass ein Bezahlmodell automatisch mehr Kontrolle und besseren Datenschutz bedeutet. Heute sehe ich das deutlich kritischer.

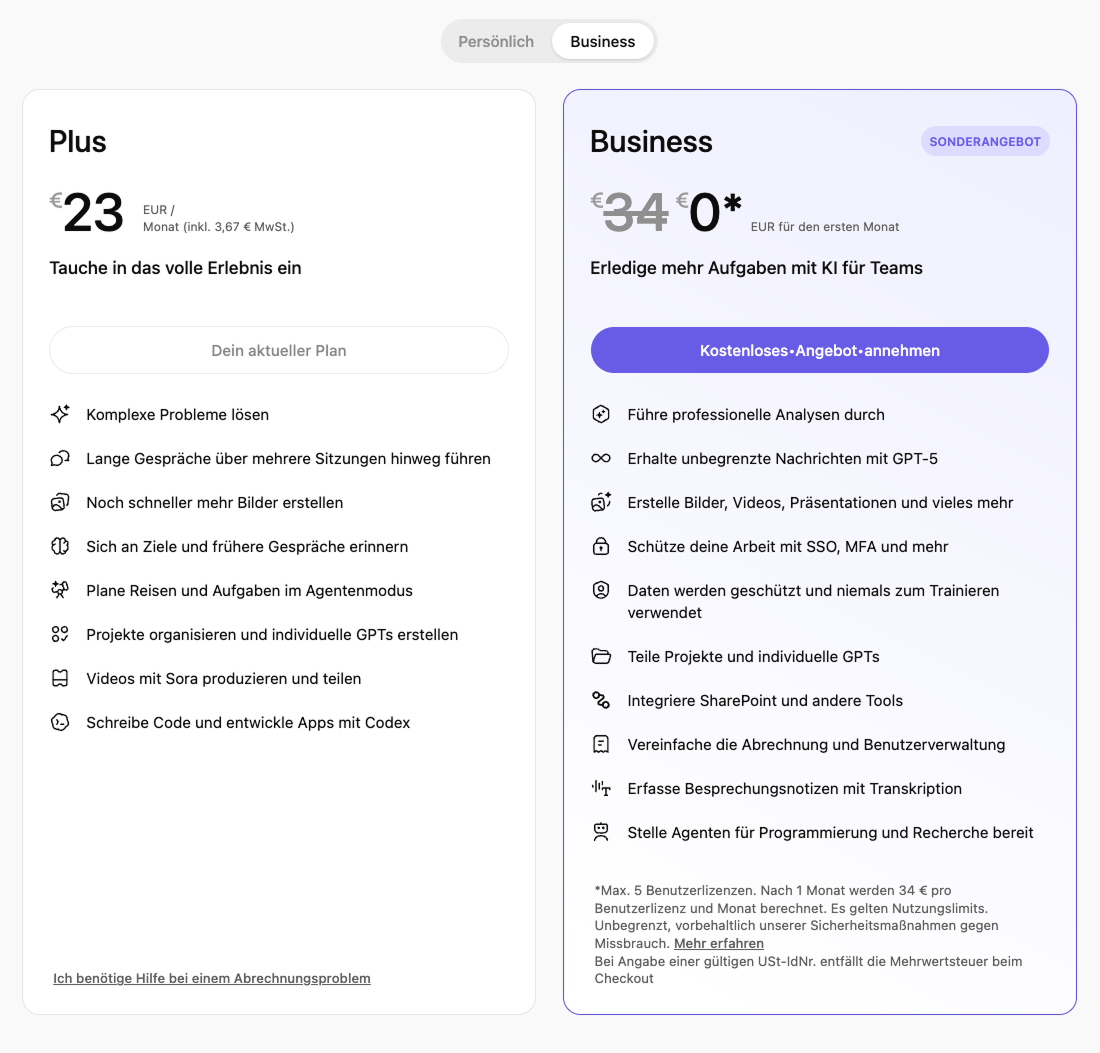

In persönlichen ChatGPT-Workspaces ist die Datennutzung zur Modellverbesserung standardmäßig aktiviert. Wer das nicht möchte, muss unter den „Data Controls“ die Option „Improve the model for everyone“ aktiv ausschalten. Erst dann werden neue Gespräche nicht mehr fürs Training genutzt. Gleichzeitig wirbt OpenAI für seine Business- und Enterprise-Angebote mit deutlich weitergehenden Schutzmechanismen – etwa mit Admin-Kontrollen, SAML SSO, MFA sowie der Zusage, Unternehmensdaten standardmäßig nicht für das Training zu verwenden. Genau darin zeigt sich der Unterschied: Ein bezahlter Consumer-Tarif ist noch lange nicht dasselbe wie ein Datenschutz stärkerer Business-Kontext, das wurde im Laufe der Zeit einfach geändert.

Spannend das GPT jetzt eine Business Aktion hat:

Vielleicht ist genau das die unangenehme Wahrheit hinter der aktuellen Kritik: Nicht nur OpenAI hat sich verändert. Auch unser Blick auf KI verändert sich. Plötzlich reicht es nicht mehr, dass ein Modell schnell, eloquent und praktisch ist. Menschen fragen wieder nach Macht, Infrastruktur und Verantwortung. Nicht mehr nur: Was kann das Tool? Sondern auch: Wofür wird es eingesetzt? Und welche Art von Welt unterstütze ich mit meiner täglichen Nutzung?

Es gibt mehr als drei Platzhirsche

Schade ist nur, dass die Debatte trotzdem fast immer wieder bei denselben drei Namen landet: ChatGPT, Claude und Gemini von Google. Als gäbe es daneben nichts. Natürlich sind diese drei aus guten Gründen führend. ChatGPT ist der breiteste Allrounder – mit großem Ökosystem, GPT Store und vielen Produktfunktionen in einem System. Claude ist stark bei langen Dokumenten, Analyse, Schreiben und Coding; dazu kommt inzwischen ein offizieller Import- und Export-Workflow für Memory. Gemini von Google spielt seine Stärken vor allem dort aus, wo Google ohnehin schon der Arbeitsraum ist – also in Gmail, Docs, Drive und Meet – und die aktuellen Gemini-3-Modelle sind nativ multimodal mit bis zu 1 Million Tokens Kontext in Gemini 3.1 Pro.

Trotzdem erzählen diese drei auch dieselbe Geschichte: KI als zentralisierte Plattformlogik großer US-Unternehmen. Das macht sie nicht automatisch schlecht. Aber es verengt unsere Vorstellung davon, wie KI aussehen kann. Denn wenn wir immer nur über die Platzhirsche reden, verwechseln wir Marktführerschaft irgendwann mit Alternativlosigkeit.

Dabei gibt es längst Gegenentwürfe. Lumo von Proton ist so einer. Hinter Lumo steht ein Schweizer Unternehmen, das seinen Assistenten als privacy-first positioniert – mit No-Logs-Ansatz, Zero-Access Encryption, europäischer Rechtsordnung und dem klaren Versprechen, Chats nicht fürs Training zu verwenden. Das ist kein Beweis dafür, dass Lumo in jeder Disziplin besser ist als ChatGPT, Claude oder Gemini. Aber es ist ein ernstzunehmender Hinweis darauf, dass ein KI-Assistent nicht zwangsläufig auf Datenhunger und maximale Verwertung gebaut sein muss.

Auch Confer, der neue Chatbot von Signal-Mitgründer Moxie Marlinspike, ist in diesem Zusammenhang spannend. Dort geht es weniger um schön formulierte Privacy-Versprechen und mehr um Datenschutz durch Architektur: private, verschlüsselte KI-Nutzung als technischer Gegenentwurf zum üblichen Plattformmodell. Confer ist der Versuch, KI so zu bauen, dass der Betreiber eben nicht einfach normalen Einblick in die Inhalte bekommt. Noch ist das kein Massenprodukt. Aber vielleicht muss es das auch gar nicht sofort sein, um wichtig zu sein.

Ein guter Service muss nicht kostenlos sein

An diesem Punkt kommt ein Satz ins Spiel, den wir in der Tech-Welt viel zu selten ernst nehmen: Ein guter Service muss nicht kostenlos sein. Im Gegenteil. Wenn wir Datenschutz, Transparenz und digitale Selbstbestimmung wirklich wollen, dann sollten wir auch bereit sein, für solche Dienste zu bezahlen. Sonst zahlen wir am Ende trotzdem – nur eben nicht mit Geld, sondern mit Abhängigkeit, Intransparenz und dem stillen Verlust von Kontrolle.

Gleichzeitig zeigt gerade der Blick auf die großen Anbieter, wie beweglich Datenschutz inzwischen geworden ist. Auch bei ChatGPT haben sich Regeln und Standards im Laufe der Zeit verändert. Und genau das macht die aktuelle Diskussion so relevant: Datenschutz ist heute oft keine feste Eigenschaft eines Tools, sondern ein Zusammenspiel aus Einstellungen, Produktkontext und Geschäftsmodell.

Was ich an Claude im Moment tatsächlich interessant finde, ist deshalb nicht nur die Modellqualität, sondern eine sehr konkrete Antwort auf einen echten Schmerzpunkt vieler Nutzender: Anthropic bietet inzwischen einen offiziellen Memory-Import und -Export an. Genau das adressiert das Problem, beim Wechsel wieder bei null anfangen zu müssen. Denn die eigentliche Hürde ist oft nicht das Tool selbst, sondern die über Monate gewachsene Arbeitslogik, die man mit ihm aufgebaut hat.

Zugleich wäre es naiv, Claude deshalb einfach zum Datenschutzsieger zu erklären. Anthropic hat seine Consumer-Richtlinien 2025 geändert: Bei Free-, Pro- und Max-Konten kann Datenverwendung für Modelltraining erlaubt werden, während für kommerzielle Produkte wie Claude for Work und die API standardmäßig andere Regeln gelten. Auch hier gilt also: Nicht das Label entscheidet, sondern der konkrete Produktkontext – und die Einstellungen der Nutzenden.

Mein nächster Schritt: nicht Aktionismus, sondern Klärung

Genau deshalb ist mein nächster Schritt gerade nicht blinder Aktionismus, sondern Klärung. Ich will bewusster entscheiden, wofür ich KI überhaupt nutze. Für schnelle Alltagsaufgaben? Für Ideen? Für Textarbeit? Für sensible Inhalte? Und ich will ehrlicher auf das Thema Datenschutz schauen – nicht als Marketingbegriff, sondern als konkrete Praxis. Welche Daten landen wo? Was ist Standard, was nur Option? Und welche Kompromisse gehe ich bewusst ein?Ob ich ChatGPT am Ende kündige, lasse ich deshalb noch offen. Aber falls ich gehe, dann will ich es sauber tun. Denn „Abo kündigen“ bedeutet noch lange nicht, dass damit auch alle Daten verschwunden sind.

Was man beachten sollte, wenn man den ChatGPT-Account wirklich verlassen will

1. Zuerst die Trainingsnutzung ausschalten

In ChatGPT lässt sich unter den „Data Controls“ die Option „Improve the model for everyone“ deaktivieren. Dann werden neue Gespräche zwar weiterhin im Verlauf angezeigt, aber nicht mehr zur Verbesserung von ChatGPT genutzt. Das ist der erste Schritt, wenn man Abstand gewinnen will, ohne sofort alles zu verlieren.

2. Danach die eigenen Daten exportieren

OpenAI bietet einen Export direkt in ChatGPT oder über das Privacy Portal an. Der Export ist wichtig, wenn man Chatverläufe, Denkprozesse oder Arbeitskontext später noch als Referenz braucht. Sonst löscht man womöglich zuerst und merkt danach, dass man genau diese Inhalte noch gebraucht hätte.

3. Sensible Chats wirklich löschen – nicht nur archivieren

Archivieren ist kein Löschen. Wer vertrauliche Gespräche aus dem Account entfernen will, muss sie gezielt löschen. OpenAI schreibt, dass gelöschte Daten grundsätzlich innerhalb von 30 Tagen gelöscht werden – ausgenommen begrenzte Fälle, in denen eine längere Aufbewahrung gesetzlich erlaubt oder erforderlich ist.

4. Shared Links widerrufen

Ein Punkt, den viele übersehen: Bereits geteilte Chat-Links verschwinden nicht automatisch, wenn man Training deaktiviert oder die Historie ausblendet. In den Data Controls lassen sich diese Links einzeln oder gesammelt entfernen.

5. Erst dann das Abo kündigen

Wer über chatgpt.com abgeschlossen hat, kann unter Profil → Settings → Account → Manage → Cancel Subscription kündigen. Wer über Apple oder Google bezahlt, muss im jeweiligen Store kündigen. Gerade das ist wichtig: Das Löschen des Accounts beendet ein mobiles Store-Abo nicht automatisch; App-Store- und Play-Store-Abos müssen separat gekündigt werden, um weitere Kosten zu vermeiden.

6. Und nur wenn man wirklich sicher ist: den Account löschen

Die Kontolöschung ist dauerhaft und kann nicht rückgängig gemacht werden. OpenAI schreibt, dass der Zugriff auf ChatGPT und andere OpenAI-Dienste damit endet und die Daten innerhalb von 30 Tagen gelöscht werden – vorbehaltlich gesetzlicher Ausnahmen. Das ist der letzte Schritt, nicht der erste.

Mein eigentliches Fazit

Vielleicht ist die interessanteste Frage gerade gar nicht, ob OpenAI Nutzer:innen „in Scharen“ verliert. Sondern warum ein Pentagon-Deal so unmittelbar spürbar macht, was wir sonst gern verdrängen: dass KI-Tools keine neutralen Werkzeuge sind. Sie verkörpern Geschäftsmodelle, Machtverhältnisse, politische Entscheidungen und Wertvorstellungen.

Und vielleicht ist das die eigentliche Chance in dieser Debatte. Nicht nur reflexhaft von einem Tool zum anderen zu springen. Sondern endlich präziser zu werden – bei den eigenen Gewohnheiten, beim Datenschutz, bei der Frage, welchen Diensten wir vertrauen, und bei der Bereitschaft, für die Art von Technologie zu bezahlen, die wir uns eigentlich wünschen.

Ich weiß noch nicht, ob ich ChatGPT endgültig verlasse. Ich prüfe gerade Alternativen. Aber ich weiß, dass ich es nicht mehr einfach nur benutze, ohne die Konsequenzen mitzudenken. Und vielleicht ist genau das der Anfang einer reiferen KI-Nutzung: nicht nur zu fragen, was ein Modell für mich leisten kann, sondern auch, was ich mit meiner Nutzung mittrage.

Einige Gedanken dazu habe ich auch auf LinkedIn geteilt.

Über weitere Hinweise auf gute Alternativen freue ich mich dort sehr.

Zum Beitrag auf LinkedIn: Link

Zum Weiterlesen

Zum Pentagon-Deal und der unmittelbaren Reaktion

it-daily: ChatGPT-Deinstallationen steigen um 295 % nach Pentagon-Deal

🔗 Quelle: https://www.it-daily.net/it-management/chatgpt-deinstallationen

Golem: Protestwelle gegen OpenAI wegen Pentagon-Deal

🔗 Quelle: https://www.golem.de/news/kuenstliche-intelligenz-protestwelle-gegen-openai-wegen-pentagon-deal-2603-205971.html

heise online: Nach Bruch mit Anthropic: Pentagon schließt KI-Deal offenbar mit OpenAI

🔗 Quelle: https://www.heise.de/news/OpenAI-erhaelt-wohl-Pentagon-Auftrag-nach-Bruch-mit-Anthropic-11193881.html

t3n: ChatGPT-Nutzer fliehen nach Pentagon-Deal in Scharen: Was OpenAI-Chef Altman jetzt sagt

🔗 Quelle: https://t3n.de/news/pentagon-deal-openai-altman-1732126

Zu datenschutzfreundlicheren Alternativen

taz zu Confer: KI, aber mit Datenschutz

🔗 Quelle: https://taz.de/Neuer-Chatbot-Confer/!6148063

heise zu Lumo: Proton veröffentlicht datenschutzfreundlichen KI-Chatbot Lumo

🔗 Quelle: https://www.heise.de/news/Proton-veroeffentlicht-datenschutzfreundlichen-KI-Chatbot-Lumo-10498983.html